目录 · TABLE OF CONTENTS

| # | 章节 | 内容 |

|---|---|---|

| 1 | 全景导读 | Agent Memory 为什么重要?3 年演进脉络 |

| 2 | 记忆分类学 | 形式 · 功能 · 动力学的三维分类框架 |

| 3 | 里程碑论文 TOP 10 | Generative Agents, Reflexion, MemGPT, Mem0, MAGMA ... |

| 4 | 其余 12 篇速览 | 完整论文列表,一句话摘要 |

| 5 | 技术架构对比 | 记忆类型 · 存储方式 · 检索机制全对比 |

| 6 | 基准测试对比 | LongMemEval, LoCoMo 及框架表现 |

| 7 | 开源框架盘点 | MemGPT/Letta, Mem0, LangChain, LlamaIndex |

| 8 | 趋势与展望 | RL + Memory, 多模态记忆, 多 Agent 共享记忆 |

| 9 | 参考文献 | 全部 22 篇论文 |

全景导读:Agent Memory 为什么是 LLM Agent 的核心能力?

大语言模型 (LLM) 正从静态的文本生成器演进为能够与环境持续交互的 Agent。然而,即使是最先进的 LLM 也面临一个根本性限制:上下文窗口是有限的,且推理过程中参数无法实时更新。这意味着,如果没有外部记忆系统,Agent 在每次对话结束后就会"失忆"——无法记住用户偏好、无法从过去的错误中学习、无法积累跨任务的经验。

Agent Memory 正是解决这一问题的关键基础设施。它使 Agent 具备持久化存储、动态检索和自主进化的能力,从而支撑长程推理、持续适应和多轮交互。从个性化聊天机器人到自动化软件工程,从社会模拟到金融分析,Agent Memory 是连接"一次性推理"与"持续智能"的桥梁。

过去三年,Agent Memory 领域经历了四个阶段的快速演进:

然而,领域也面临严峻挑战。Anatomy of Agentic Memory[13] 的实证分析表明:现有基准存在上下文饱和风险(许多测试集可以完全放入 128K 上下文窗口)、词汇匹配指标与语义质量严重错位(F1 分数无法反映真正的记忆能力)、开源模型在记忆维护操作中格式错误率高达 30%。这些问题意味着,当前的 Agent Memory 系统"理论上很强,实际部署时问题重重"。

记忆分类学:形式 · 功能 · 动力学

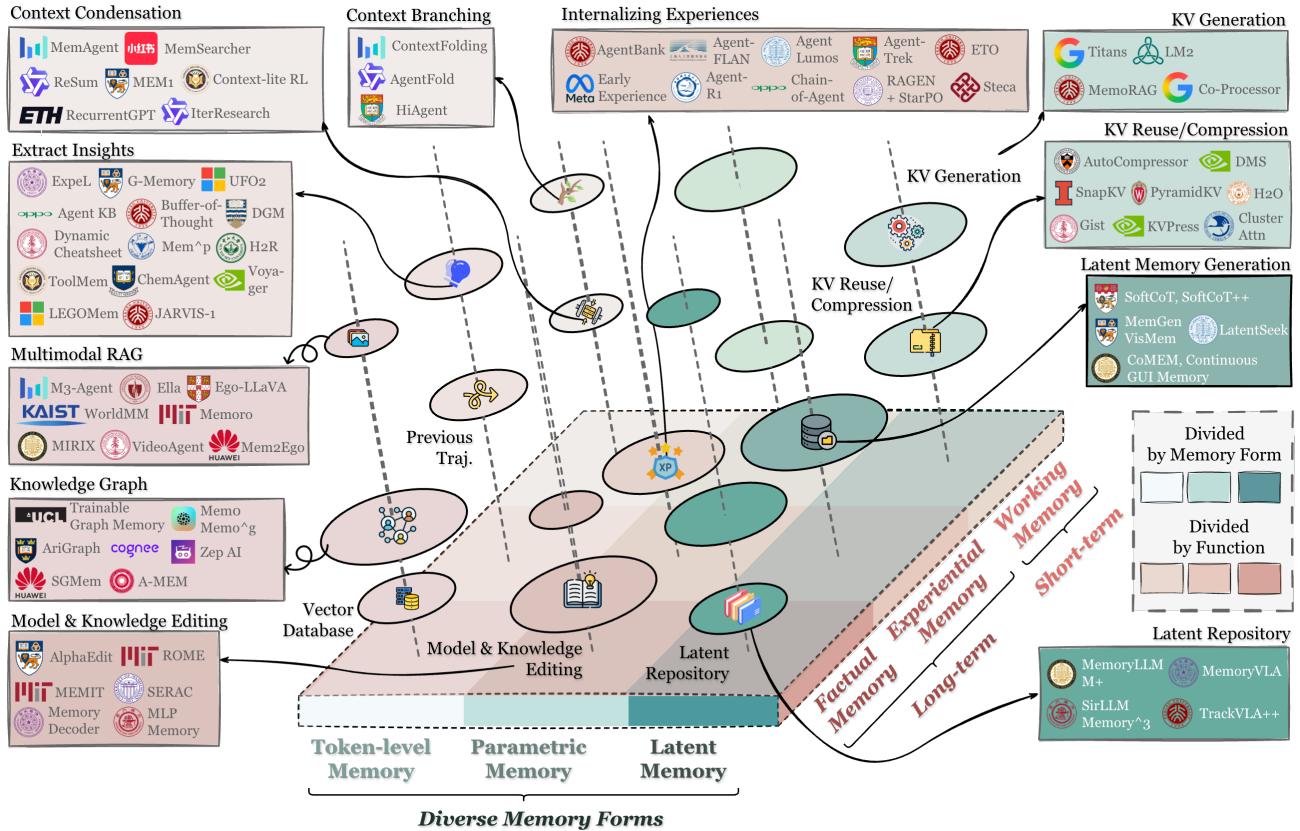

Memory in the Age of AI Agents[14] 提出了一个统一的三维分类框架:"Forms – Functions – Dynamics",比传统的"短期/长期记忆"二分法更加精确地刻画了 Agent Memory 的多样性。

维度一:形式 (Forms) — 记忆以什么载体存在?

Token-level Memory

以显式、离散的文本单元存储。包括 1D 扁平记忆(如对话历史缓冲区)、2D 平面记忆(如知识图谱三元组)、3D 层级记忆(如社区摘要层级)。可直接访问、修改和重构。代表系统:MemGPT, Mem0, A-MEM。

Parametric Memory

编码在模型参数中,通过前向计算隐式访问。分为内部参数记忆(如 LoRA 微调注入的知识)和外部参数记忆(如 Memory3 的显式可训练记忆参数)。优势是零检索延迟,但更新成本高且缺乏可解释性。

Latent Memory

以模型内部隐状态或连续向量表示。可通过生成(如 Gist Token 压缩)、复用(如 KV Cache 持久化)、转换(如隐空间映射)三种方式构建。适合高效压缩但牺牲细粒度控制。代表系统:MemGen, TokMem。

维度二:功能 (Functions) — Agent 为什么需要记忆?

Factual Memory (事实记忆)

存储和检索关于用户、环境的显式声明性事实。包括用户事实记忆(偏好、个人信息)和环境事实记忆(工具状态、世界知识)。是个性化和上下文感知的基础。

Experiential Memory (经验记忆)

从任务执行中积累的过程性知识。包括案例记忆(过去的成功/失败经验)、策略记忆(抽象行动规则)、技能记忆(可复用的代码/工具调用序列)。是 Agent 自我进化的核心。代表:Voyager 的技能库、Reflexion 的反思缓冲区。

Working Memory (工作记忆)

管理当前任务执行过程中的瞬态上下文。单轮工作记忆管理推理中间状态(如 Chain-of-Thought 过程),多轮工作记忆在长对话中维护任务状态和上下文连贯性。

维度三:动力学 (Dynamics) — 记忆如何运作和演化?

Formation (形成)

从原始交互中提取记忆候选。方法包括语义摘要(压缩冗余信息)、知识蒸馏(从轨迹中提取可复用模式)、结构化构建(实体/关系三元组提取)、参数内化(写入模型权重)。

Evolution (演化)

记忆的持续维护和优化。包括巩固(合并冗余条目)、更新(冲突解决和事实修正)、遗忘(淘汰低效用记忆以控制规模)。这是 Agent Memory 区别于静态 RAG 的关键特征。

Retrieval (检索)

上下文感知的记忆访问。涉及检索时机判断(何时需要检索)、查询构造(如何从当前状态生成检索查询)、检索策略(语义相似度、时间衰减、图遍历等)、后处理(重排序、去噪、摘要集成)。

Anatomy of Agentic Memory[13] 从实证角度提出了另一个互补分类,将记忆系统分为四种结构类型:轻量语义记忆(向量存储 + top-k 检索)、实体中心记忆(围绕用户/实体的结构化记录)、情景反思记忆(带时间抽象的情景巩固)、结构层级记忆(多层存储 + 图结构 + 策略优化)。两套分类框架从不同视角互相印证,共同构成了理解 Agent Memory 的完整图景。

里程碑论文深度解读 TOP 10

#1 Generative Agents: Interactive Simulacra of Human Behavior

这是 Agent Memory 领域的奠基之作。Stanford Smallville 项目构建了一个由 25 个生成式 Agent 组成的虚拟小镇,每个 Agent 拥有独立的记忆系统,能够自主社交、规划日程、形成关系。

其核心记忆架构由三层组成:记忆流 (Memory Stream) 作为底层存储,以自然语言描述的形式记录 Agent 的所有观察和行为;反思 (Reflection) 机制定期从记忆流中提取高级抽象(如"我和 Bob 是好朋友");规划 (Planning) 利用记忆流和反思结果生成未来行动计划。检索时综合考虑时间衰减 (recency)、重要性 (importance) 和相关性 (relevance) 三个维度。

这一架构的深远影响在于:它首次证明了单纯通过记忆机制就能涌现出可信的类人行为——Agent 会自发组织聚会、传播信息、形成和解除关系。后续几乎所有 Agent Memory 工作都直接或间接受到这一框架的启发。

#2 Reflexion: Language Agents with Verbal Reinforcement Learning

如果说 Generative Agents 展示了记忆如何支撑社会模拟,Reflexion 则展示了记忆如何支撑自我改进。传统强化学习通过标量奖励更新参数,但 LLM 的参数更新成本极高。Reflexion 提出了一种"语言强化学习"范式:Agent 在任务失败后生成自然语言反思(如"我在第 3 步选错了工具,因为……"),并将这些反思存入情景记忆缓冲区。下次遇到类似任务时,这些反思作为经验被注入上下文。

在 HumanEval 编程基准上,Reflexion 将 pass@1 从 baseline 的 67% 提升到 91%;在 AlfWorld 决策基准上,从 45% 提升到 97%。关键发现是:语言反思比标量奖励携带了更多的结构化信息,使 Agent 能够在不更新参数的情况下实现类似"在线学习"的效果。

#3 Voyager: An Open-Ended Embodied Agent with Large Language Models

Voyager 是首个在 Minecraft 中实现终身学习的 LLM Agent。它的记忆系统采用了一种独特的形式:技能库 (Skill Library)。每当 Agent 成功完成一个子任务,它生成的代码就会被抽象为一个可复用的技能函数,并存入向量数据库。下次遇到相似情境时,通过语义检索调用已有技能,而非从头生成代码。

系统由三个模块协同工作:自动课程生成器 (Automatic Curriculum) 根据当前状态提出下一个探索目标;迭代提示机制 (Iterative Prompting) 通过环境反馈和自我验证迭代改进代码;技能库 实现经验的持久化和复用。相比 ReAct 和 AutoGPT 等基线,Voyager 发现的独特物品数量多 3.3 倍,技能掌握速度快 15 倍。

#4 MemGPT: Towards LLMs as Operating Systems

MemGPT 做了一个影响深远的类比:LLM 的上下文窗口就像操作系统的物理内存——有限、易失,需要虚拟化管理。基于这一洞察,MemGPT 构建了一个多层级虚拟上下文管理系统:主上下文 (main context) 相当于内存,外部存储 (archival storage) 相当于磁盘,Agent 通过显式的 memory 函数调用在两者之间搬运数据。

与之前的记忆系统不同,MemGPT 的记忆操作是Agent 自主触发的:它会根据当前对话需要,主动决定何时将信息写入外部存储、何时从外部存储加载回上下文。这种中断驱动 (interrupt-driven) 的控制流使得 Agent 能够处理远超上下文窗口限制的超长对话和大文档分析。MemGPT 后来发展为 Letta 框架,成为最早的生产级 Agent Memory 开源项目之一。

#5 Mem0: Building Production-Ready AI Agents with Scalable Long-Term Memory

如果说前面的工作主要面向学术研究,Mem0 则是第一个明确面向生产部署的 Agent Memory 框架。它的核心创新是图记忆 (Graph Memory):将对话中的信息自动提取为实体-关系三元组,构建一个持续演化的知识图谱。相比纯向量检索,图结构支持多跳关联推理和冲突检测。

Mem0 在 LOCOMO 基准上的表现令人印象深刻:相比 OpenAI 的记忆功能提升 26%,p95 延迟降低 91%,token 消耗减少 90% 以上。其架构设计围绕三个工程原则:渐进式记忆形成(不一次性处理全部历史,而是增量式更新)、双重存储(向量 + 图谱并行)、冲突感知更新(新信息与已有记忆矛盾时的自动处理)。